圖為工人在河北滄州中捷高新區一間汽車部件生産項目廠房內調試焊接機器人。新華社記者 楊世堯攝

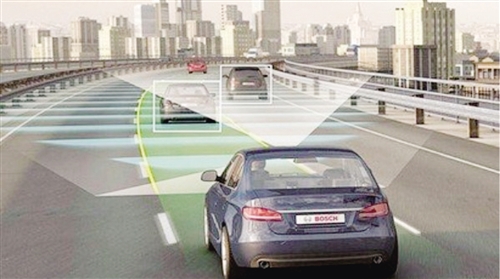

由於無人駕駛汽車的無人操作與各國現有道路交通法規抵觸,相應立法和規範一直是其發展的重要前提條件。圖為無人駕駛汽車的探測方式模擬圖。

中國科技大學研製的智慧機器人與小朋友互動。 (資料圖片)

人工智能可以同聲傳譯、寫新聞稿、協助醫生看病、讓機器人臉識別的精度高於人類、甚至寫詩和戰勝圍棋世界冠軍,其應用可謂“百花齊放”。

數據顯示,截至2017年6月,全球人工智能企業總數達到2542家,預計到2030年,人工智能將為世界經濟貢獻15.7萬億美元

在今年7月國務院印發的《新一代人工智能發展規劃》(以下簡稱《規劃》)中提出,到2020年,我國人工智能核心産業規模超過1500億元,帶動相關産業規模超過1萬億元。頂層設計相繼出臺,巨頭髮力佈局生態,資本市場熱情洋溢,細分行業獨角獸不斷涌現,人工智能這片“花海”已不止“看上去很美”。

但“花海”之下仍有“荊棘”。市場研究機構埃森哲大中華區信息技術服務總裁陳笑冰坦言:“人工智能也將會引發新的安全和倫理問題,鋻於未來人工智能將深入生活,政府也需要切實為人工智能制定監管規則,保證人工智能應用合理合規發展。”《規劃》也同時提出:“人工智能發展的不確定性帶來新挑戰。人工智能是影響面廣的顛覆性技術,可能帶來改變就業結構、衝擊法律與社會倫理、侵犯個人隱私、挑戰國際關係準則等問題,將對政府管理、經濟安全和社會穩定乃至全球治理産生深遠影響。”

人工智能發展將面對怎樣的挑戰與風險?又應該設立怎樣的“遊戲規則”,讓新技術能夠與人類社會良性互動?

監管剛剛起步

人工智能不斷融入人類生活的同時,也引發公眾對人工智能的憂慮。對此,專家表示,應該建立監管機構來引導、促進和保障人工智能的健康發展

此前有報道稱,“臉書”人工智能研究所中的兩個聊天機器人“失控”,發展出了人類無法理解的語言,“被迫關閉”引發了廣泛關注。儘管隨後被證明是一場“烏龍”,只是因為工程師忘記加入“使用英語語法”這一條件。

但對事實的誇大報道,也顯示出媒體和公眾對人工智能的憂慮。在北京市中盾律師事務所律師陳濤看來,隨著人工智能深入融入生産和生活,必須以立法來對其安全性進行監管,給公眾吃下“定心丸”。互聯網汽車的特斯拉埃隆·馬斯克也表示,我們應該警惕人工智能崛起的潛在風險,並建立監管機構來引導這項強大技術的發展。

對人工智能進行立法監管,首先要解決人工智能使用中基本的安全問題,以及使用者與服務提供者的責任界定問題。以無人駕駛汽車為例,上路前,對其安全性如何全面評判?一旦無人駕駛汽車出現事故,如何判斷使用者、軟體提供商以及車輛製造商等多方主體的責任,如何在後續賠償和保險理賠中進行規定?實際上,立法監管不僅降低風險,也讓服務企業能夠“有據可依”,從而促進和保障人工智能的健康發展。

從目前來看,各個國家的人工智能監管都剛剛被提上日程。在美國,2016年10月,總統行政辦公室和國家科技委員會發佈了兩份重量級報告:《美國國家人工智能研究發展戰略規劃》與《為未來的人工智能做好準備》,後者提出了發展人工智能的7項關鍵戰略,在第三條“社會影響戰略”中,提出“理解和確定人工智能在法律、倫理和社會領域中的影響”;在第四條“安全戰略”中,則提出“確保人工智能系統的安全和對公眾的隱私保護”。

在歐盟,2016年歐盟法律事務委員會向歐盟提交了《歐盟機器人民事法律規則》,針對基於人工智能控制的機器人,提出了使用的責任規則、倫理原則、對人類自身和財産的傷害賠償等監管原則。英國下議院科學技術委員會在今年4月表示,也將開展關於人工智能監管的研究。

在我國,《規劃》中同樣提出,到2020年,“部分領域的人工智能倫理規範和政策法規初步建立”。其中特別提出,要“開展與人工智能應用相關的民事與刑事責任確認、隱私和産權保護、信息安全利用等法律問題研究,建立追溯和問責制度,明確人工智能法律主體以及相關權利、義務和責任等”,“重點圍繞自動駕駛、服務機器人等應用基礎較好的細分領域,加快研究制定相關安全管理法規,為新技術的快速應用奠定法律基礎”。

不過,對人工智能的監管也不能“閉門造車”。“立法的前提是了解人工智能的科學規律,需要充分準備、摸索和積累,對技術進步充分了解,同時考慮公眾的實際需求。”陳濤表示。

安全仍有漏洞

安全是人工智能面臨的巨大挑戰。這其中既包括在應用層面的傳統駭客攻擊方式,也存在著對基礎設施方面進行的數據庫、雲服務等攻擊。但更關鍵的安全問題是從最核心的演算法層面發起攻擊

兩張人眼看起來一模一樣的熊貓圖片,一張被神經網絡正確識別為“熊貓”,另外一張卻因為被加上了人眼難以察覺的微小擾動,就被神經網絡以99.3%的置信度識別為“長臂猿”——這就是可以“愚弄”人工智能的對抗樣本,直接折射出人工智能所面對的安全問題縮影。

專注于互聯網安全的極棒實驗室總監王海兵告訴《經濟日報》記者:“安全是人工智能面臨的巨大挑戰。”他表示,一方面,人工智能要面對傳統的駭客攻擊方式,比如在應用層面,可以攻擊它的作業系統或者邏輯漏洞。“比如説,通過對智慧門鎖的攻擊,就能實現任意人臉都可以通過門禁。”在人工智能的基礎設施方面,則可以對人工智能使用的數據庫、雲服務等進行攻擊,“比如説,機器視覺經常調用的OpenCv庫,機器學習用到的TensorFlow框架,人工智能的從業者可以直接調用這些服務,但不幸的是,這些基礎設施同樣有漏洞。”王海兵説。

然而,人工智能所面對的更關鍵安全問題,正是諸如熊貓圖片這樣的對抗樣本。王海兵表示:“用對抗樣本攻擊人工智能,其實就是從最核心的演算法層面來攻擊它。”

美國加州大學伯克利分校教授宋曉冬這樣介紹對抗樣本攻擊的危害:“比如,無人駕駛汽車根據交通標示進行決策。如果交通標示是一個對抗樣本,那麼人類可以完全不受干擾,但無人駕駛汽車卻可能將它完全識別成錯誤信息,這將帶來嚴重後果。”實際上,美國伊利諾伊大學的一項測試已經證明,自動駕駛系統有可能被對抗樣本“矇騙”。

“但公眾不用過於擔心,至少現在來看,針對自動駕駛的對抗樣本對抗性很差。比如,它只能在0.5米的距離內讓自動駕駛系統錯判,但自動駕駛場景畢竟是逐漸接近交通標識的。”王海兵也表示,“未來會不會有更完美的對抗樣本,仍是未知數”。

人工智能面對眾多安全問題,對此,開發者也在努力總結與之對抗的手段。智慧家居生産廠商BroadLink高級副總裁康海洋表示:“我們會將多方數據融合和統一分析,以提升數據的可信程度,同時也在儘量讓整個系統變得更加透明。此外,我們還會及時銷毀所有能銷毀的數據,減少用戶被攻擊的可能性。”

倫理尚待明確

告訴人工智能何為“正確”,正在成為當務之急。如果不對其進化方向和目標形成共識,人工智能的倫理規則將無法“落地”

如果保持前行,會撞上沿途的5位行人;如果避開他們,就會撞上路邊的墻,車中的兩名乘客則可能有生命危險。在這種情況下,指揮自動駕駛的人工智能應該如何選擇?英國倫敦瑪麗女王大學高級講師雅思密·艾登表示:“如果是人類駕駛員,大可以直接撞上行人,並表示‘是他們自己突然跳出來的’,但人工智能在道德上很難獲得這麼奢侈的原諒。”

這只是人工智能所處倫理困境的冰山一角。今年以來,麻省理工和哈佛大學聯合推出了人工智能倫理研究計劃,微軟和谷歌等巨頭也成立了人工智能倫理委員會,告訴人工智能何為“正確”,正在成為當務之急。《互聯網進化論》一書的作者、計算機博士劉鋒坦言:“儘管大方向上説,人工智能應當以造福人類為前提,但如果不對進化方向和目標形成共識,人工智能的倫理規則將無法‘落地’。”

對於人工智能來説,“倫理正確”的核心是正確的“演算法”。美國一些法院使用的一個人工智能犯罪風險評估演算法COMPAS,被第三方機構認為對黑人造成了系統性歧視。業界因此懷疑,小眾人群有可能因為個體差異而承受“演算法的歧視”。騰訊研究院研究員曹建峰表示,如果演算法本身有問題,一旦將演算法應用在犯罪評估、信用貸款、雇傭評估等關乎人身利益的場合,“因為它是規模化運作的,並不是僅僅針對某一個人,可能影響具有類似情況的一群人或者種族的利益。規模性是很大的”。

此外,還有來自數據的風險。以色列歷史學家尤瓦爾·赫拉利表示,“人工智能技術的一個潛在結果是:促成數據集中到某一個地方,也進而導致權力的集中”。比如,大量互聯網數據集中在少數幾家巨頭的手中,人工智能技術是否會因此遭到壟斷?“AlphaGo之父”哈薩比斯就曾表示:“我提醒諸位,必須正確地使用人工智能。”他告訴記者,“人工智能技術不能僅為少數公司和少數人所使用,必須共享”。

AlphaGo超越了人類幾千年來對圍棋的理解,但人類並非能完全理解AlphaGo為何會如此決策。從這一點來看,人工智能像個“魔盒”,這也讓透明性成為人工智能倫理中的重要組成部分。英國阿蘭圖靈研究所科研主管安德魯·布萊克表示,演算法可問責性的存在至關重要。“透明性規則應被作為倫理道德準則,編入演算法之中,這樣人們才能更為清晰地認知人工智能的社會影響,並在問題發生之時能夠及時找出原因,調整策略。”(記者 陳靜)

1、“國際在線”由中國國際廣播電臺主辦。經中國國際廣播電臺授權,國廣國際在線網絡(北京)有限公司獨家負責“國際在線”網站的市場經營。

2、凡本網註明“來源:國際在線”的所有信息內容,未經書面授權,任何單位及個人不得轉載、摘編、複製或利用其他方式使用。

3、“國際在線”自有版權信息(包括但不限于“國際在線專稿”、“國際在線消息”、“國際在線XX消息”“國際在線報道”“國際在線XX報道”等信息內容,但明確標注為第三方版權的內容除外)均由國廣國際在線網絡(北京)有限公司統一管理和銷售。

已取得國廣國際在線網絡(北京)有限公司使用授權的被授權人,應嚴格在授權範圍內使用,不得超範圍使用,使用時應註明“來源:國際在線”。違反上述聲明者,本網將追究其相關法律責任。

任何未與國廣國際在線網絡(北京)有限公司簽訂相關協議或未取得授權書的公司、媒體、網站和個人均無權銷售、使用“國際在線”網站的自有版權信息産品。否則,國廣國際在線網絡(北京)有限公司將採取法律手段維護合法權益,因此産生的損失及為此所花費的全部費用(包括但不限于律師費、訴訟費、差旅費、公證費等)全部由侵權方承擔。

4、凡本網註明“來源:XXX(非國際在線)”的作品,均轉載自其它媒體,轉載目的在於傳遞更多信息,豐富網絡文化,此類稿件並不代表本網贊同其觀點和對其真實性負責。

5、如因作品內容、版權和其他問題需要與本網聯繫的,請在該事由發生之日起30日內進行。